DOI:

https://doi.org/10.14483/2248762X.6359Publicado:

2014-05-28Número:

Vol. 4 Núm. 2 (2013)Sección:

InvestigaciónIMPLEMENTACIÓN DE UN SERVICIO EN LA WEB –MASHUP– PARA LA FUSIÓN DE IMÁGENES SATELITALES USANDO LA TRANSFORMADA RÁPIDA DE WAVELET HAAR

Descargas

Cómo citar

APA

ACM

ACS

ABNT

Chicago

Harvard

IEEE

MLA

Turabian

Vancouver

Descargar cita

IMPLEMENTACIÓN DE UN SERVICIO EN LA WEB –MASHUP– PARA LA FUSIÓN DE IMÁGENES SATELITALES USANDO LA TRANSFORMADA RÁPIDA DE WAVELET HAAR

IMPLEMENTATION OF A WEB SERVICE (MASHUP) FOR SATELLITE IMAGE FUSION BASED ON FAST HAAR WAVELET TRANSFORM

Rubén J. Medina D. 1, Luis Joyanes 2, Carlos Pinilla 3, Oscar Ardila 4, Fernando Pineda 1

1 Universidad Distrital Francisco José de Caldas, Bogotá - Colombia, 2 Universidad Pontificia de Salamanca Campus Madrid, 3 Universidad Jaen, 4 Globant

rmedina@udistrital.edu.co, luis.joyanes@upsam.net, cpinilla@ujaen.es, ojardip@correo.udistrital.edu.co, wfpinedar@correo.udistrital.edu.co

Recibido: 07/10/2013 - Aceptado: 22/12/2013

Resumen

En este artículo se implementa un nuevo servicio en la Web que ofrece a los usuarios la posibilidad de realizar la fusión de imágenes de satélite provenientes de diferentes sensores remotos y/o con diferentes resoluciones espaciales. A lo largo del artículo tres temáticas importantes son abordadas. La primera temática corresponde al servicio Web, éste servicio es implementado usando software libre y cuenta con una sencilla interfaz donde el usuario puede interactuar y principalmente puede realizar una solicitud del servicio de fusión. Adicionalmente, en la aplicación Web se desarrolló un módulo que permite obtener datos georreferenciados de diferentes fuentes externas para crear un nuevo servicio (Mashup) a través de las API’s, de manera rápida y fácil utilizando OpenStreetMaps. La segunda temática se ocupa del análisis de la transformada rápida de wavelet haar (TRWH), estos conceptos matemáticos se abordan a partir de un ejemplo usando una matriz que se descompone en coeficientes de detalle y de aproximación de segundo nivel. La última temática detalla la metodología propuesta, paso a paso, para realizar la fusión de imágenes usando la TRWH. Igualmente con el fin de determinar la eficiencia de la TRWH cinco wavelets diferentes fueron implementadas en Matlab para fusionar el mismo par de imágenes satelitales. Las imágenes resultantes fueron evaluadas tanto en la calidad espacial como en la espectral a través de cuatro índices. Los mejores resultados de la evaluación fueron obtenidos con la TRWH la cual preserva la riqueza espectral de la imagen multiespectral original y mejora su calidad espacial.

Palabras clave: Web, MapServer, Apache, Drupal, APIs, Fusión de imágenes, Transformación RGB-IHS, Transformada de Wavelet, multiespectral, pancromática.

Abstract

This article presents the implementation of a new Web service that offers users the possibility to merge images taken from different satellite remote sensing sources and/or images with different spatial resolutions. Throughout the article three important issues are addressed. First, using freeware tools, a Web service is implemented so as to provide a simple interface for users to interact and request the image-fusion service; additionally, a module to obtain geo-referenced data from two or more external sources is developed for the Web application in order to offer a new service (Mashup) through the use of APIs, which provides a quick and easy-to-use OpenStreetMap-based service. The second issue deals with the analysis of the Fast Haar Wavelet Transform (FHWT), whose mathematical concepts are addressed by presenting an example where a matrix is decomposed into second-level detail and approximation coefficients. The final part of the article is a step-by-step description of the proposed methodology that actually performs image fusion using FHWT. In order to determine the efficiency of FHWT, five different wavelets are implemented in Matlab to merge the same pair of satellite images. By using four indices, the resulting images are assessed in terms of both spatial quality and spectral quality. The best results obtained during the assessment process correspond to FHWT, which preserves the spectral richness of the original multi-spectral image while improving spatial quality.

Keywords: Web, MapServer, Apache, Drupal, APIs, Image Fusion, RGB-IHS Transform, Wavelet Transform, multispectral, panchromatic.

1. INTRODUCCIÓN

En este artículo se muestra la utilidad de algunas herramientas tecnológicas de software libre [1], disponibles en el mundo de la informática, específicamente para ofrecer un servicio de fusión de imágenes satelitales para los usuarios de la red.

Con la información obtenida de las imágenes fusionadas se realiza una aplicación web híbrida (mashup o remezcla) [2]. Dicha aplicación es un sitio web o aplicación web que usa contenido de otras aplicaciones del mismo tipo, para crear un nuevo contenido que enriquece la información existente, consumiendo servicios Web directamente a través del protocolo http. Logrando así acceder desde el sitio Web a información externa vinculada a través de una API (del inglés Application Programming Interface) [3], permitiendo procesar todos los datos de la misma y ofreciendo así un valor agregado a los usuarios del sitio Web. El servicio principal de éste sitio Web es la fusión de imágenes satelitales. Dicha fusión es una respuesta a la frecuente necesidad de los usuarios que requieren procesar imágenes de satélite y necesitan tener en una sola imagen datos de alta resolución espectral (imágenes multiespectrales) y alta resolución espacial (pancromática) provenientes del mismo sensor o de diferentes sensores remotos. Con la fusión se obtiene información detallada sobre el medio ambiente urbano y rural, útil para muchas aplicaciones especificas como el ordenamiento territorial, la agricultura, los planes de manejo ambiental, entre otros.

Los procedimientos convencionales de fusión de imágenes están basados en diferentes técnicas, tales como la transformación RGB a IHS, Brovey, Componentes Principales, entre otros. Estos métodos no son completamente satisfactorios debido a que degradan la información espectral mientras ganan información espacial. Lo anterior a promovido, en los últimos años, la experimentación de diferentes procedimientos que usan la transformada de Wavelet en dos dimensiones, dado que estas conservan la riqueza espectral de las imágenes originales [4-6] mejorando la resolución espacial.

Basados en la hipótesis que la transformada rápida de Wavelet haar (TRWH) mejora los resultados de la fusión de imágenes satelitales [7], y que la fusión de imágenes es un servicio especializado poco frecuente en la web, este trabajo se ha centrado en tres aspectos principales. El primer aspecto es la implementación web para la fusión de imágenes satelitales. El segundo aspecto es el entendimiento de la TRWH, la cual es utilizada para la fusión de imágenes ofrecida en la web. El último aspecto se encarga de la descripción de la metodología para la fusión de imágenes satelitales usando la TRWH y de la comprobación de su rendimiento. La evaluación se realiza comparando el rendimiento de la TRWH con de otras cinco wavelets (Haar, Daubechies, dmey, BiorSplines y ReverseBior) [8-11]. La evaluación cualitativa de las imágenes fusionadas obtenidas a través de los seis métodos basados en wavelets se realizó con cuatro índices, específicamente, el coeficiente de correlación, RASE, ERGAS, y el índice de calidad universal .

El artículo está organizado en cinco secciones de la siguiente manera: la segunda sección describe las diferentes herramientas web (usando software libre) utilizadas en el sitio web que ofrece la fusión de imágenes satelitales, bajo Linux como plataforma. En la tercera sección se presenta el ejemplo de la descomposición de la TRWH. La cuarta sección se muestra la metodología e implementación de la TRWH para la fusión de imágenes, al igual que los resultados obtenidos. La quinta sección se ocupa de las conclusiones y recomendaciones.

2. METODOLOGÍA

Implementación de la TRWH para la fusión de imágenes de satélite.

Zona de Estudio

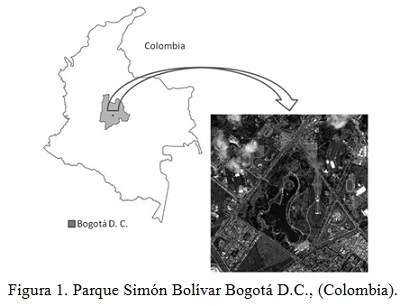

El área de estudio se localiza en Bogotá (Colombia), específicamente en el Parque Metropolitano "Simón Bolívar" ( figura 1 ).

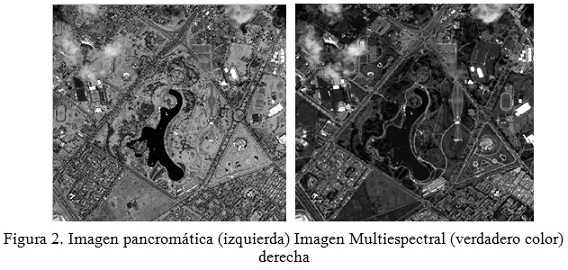

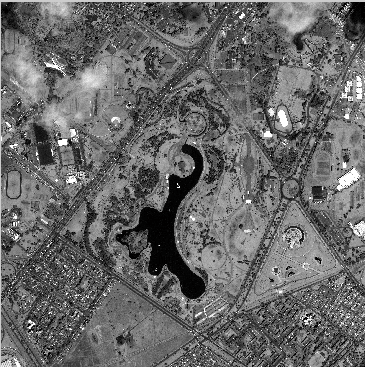

En la figura 2 se observa la zona de estudio que corresponde a un par de sub-imágenes Ikonos (Multiespectral y pancromática) que contiene parte urbana, y área con vegetación.

La zona de estudio está cubierta por una sub imagen Ikonos (figura 2) tanto pancromática como multiespectral. La sub imagen pancromática tiene un (1) metro de resolución espacial, y fue tomada el 6 de septiembre de 2007; su sistema de referencia corresponde a UTM/WGS 84. La sub imagen multiespectral cuenta con tres canales (R-rojo, G verde y azul-B) y tiene una resolución espacial de 4 metros; fue adquirida la misma fecha que la pancromática y tiene l mismo sistema de referencia.

Las dos imágenes fueron recortadas con un ancho de 2048 y de alto 2048 pixeles, para satisfacer la propiedad Diádica [5] [7]. Sobre dichas imágenes se realizaron los cálculos estadísticos para conocer el comportamiento de cada banda. Además, como parte de la preparación de los datos, la imagen multipespectral se remuestreo al mismo tamaño del pixel de la imagen pancromática.

En la figura 2 se observa un par de sub-imágenes Ikonos (Pancromática y Multiespectral) utilizadas para la fusión de imágenes satelitales correspondiente a la zona de estudio.

Método para la implementación de la TRWH

La implementación de la transformada rápida de wavelet haar para la fusión de imágenes satelitales se basa en el proceso propuesto [7] descrito anteriormente en el ejemplo, para el cual se utilizó el software Matlab.

Como resultado de esta investigación se proponen los siguientes pasos:

Paso 1. Registrar una composición a color RGB (verdadero color) de la imagen multiespectral con la imagen pancromática, usando el mismo tamaño de píxel de esta última.

Paso 2. Transformar la imagen RGB en componentes IHS (intensidad, matiz y saturación).

Paso 3. Aplicar el concepto de TRWH al componente I, iterativamente hasta el segundo nivel descomposición [11], obteniendo de esta manera los siguientes coeficientes de aproximación y detalle. cA1i coeficientes de aproximación que contienen la información espectral de la componente I, cV1i, cH1i y cD1i coeficientes de detalle donde se almacena la información espacial de I. cA1i se descompone por segunda vez, con el fin de obtienen los coeficientes de aproximación cA2i que contienen la información espectral de I. cV2i, cH2i y cD2i, junto con cV1i, cH1i y cD1i son los coeficientes de detalle donde está almacenada la información espacial de la componente I.

Paso 4. Aplicar el concepto de la TRHW a la imagen pancromática hasta el segundo nivel descomposición obteniendo de esta manera los coeficientes de aproximación y detalle. cA1p coeficientes de aproximación que contiene la información espectral de la imagen pancromática, cV1p, cH1p y cD1p coeficientes de detalle donde se almacena la información espacial de la imagen pancromática. cA1p se descompone por segunda vez obteniendo cA2p que corresponde a los coeficientes de aproximación de segundo nivel, los cuales contienen la información espectral de la imagen pancromática. cV2p, cH2p y cD2p junto con cV1p, cH1p y cD1p son los coeficientes de detalle donde está almacenada la información espacial de la imagen pancromática.

Paso 5. Generar una nueva matriz concatenando los coeficientes cA2i (que almacena la información de la componente I) y los coeficientes de detalle de segundo nivel de la imagen pancromática cV2p, cH2p ycD2p, junto con los coeficientes de detalle de la descomposición de primer nivel cV1p, cH1p y cD1p.

Paso 6. Aplicar la transformada inversa de la TRHW (I-TRWH) a la matriz obtenida en el paso anterior para obtener la nueva componente intensidad (N-INT).

Paso 7. Generar una nueva composición IHS (N-IHS), uniendo la N-INT (nuevo componente intensidad) junto con las componentes originales de matiz y saturación (obtenidas en el paso 2).

Paso 8. Realizar la transformación IHS a RGB, usando la nueva composición N-IHS. De esta manera se obtiene la nueva imagen multiespectral, que mantiene la resolución espectral ganando así la resolución espacial.

Método para la fusión de imágenes usando las trasformadas de wavelet predefinidas en MatLab

Para la fusión de imágenes satelitales usando otras wavelets predefinidas en Matlab, específicamente para éste estudio: rbio6.8, bior6.8, db7, haar y dmey se utilizó la caja de herramientas de Wavelet y de procesamiento de imágenes de Matlab [5] [12], para lo cual se proponen los siguientes seis pasos:

Paso 1. Registrar una composición a color RGB de la imagen multiespectral original, para éste caso de estudio se trabajó con la composición a color RGB (Verdadero Color).

Paso 2. Transformar la imagen RGB en componentes IHS (Intensidad, matiz y Saturación).

Paso 3. Integrar mediante una transformación de Wavelet los coeficientes de aproximación de segundo nivel de la componente I con los coeficientes de detalle de primer y de segundo nivel de descomposición de la imagen pancromática, con cada una de las wavelet (rbio6.8, bior6.8, db7, haar y dmey). De esta manera se genera las nuevas cinco matrices de coeficientes.

Paso 4. Se aplica la trasformada inversa de cada una de las wavelet a las cinco matrices obtenidas en el paso anterior y de esta forma se obtienen cinco nuevas componentes de intensidades (una por cada wavelet).

Paso 5. Con cada una de las cinco nuevas intensidades junto con la matiz y saturación originales (obtenidas en el paso dos) se generan cinco nuevos componentes NI-HS (uno por cada wavelet utilizada).

Paso 6. Realizar la transformación inversa IHS a RGB, con cada una de los cinco NI-HS. De esta manera se obtienen las nuevas imágenes fusionadas con las diferentes wavelets.

2.1. Marco teórico

Herramientas web usando software libre para la fusión de imágenes satelitales bajo la plataforma GNU/LINUX. GNU/Linux es un término el cual ha sido empleado para nombrar la combinación entre el sistema operativo GNU y el núcleo Linux, su código fuente puede ser puede ser utilizado, modificado, y redistribuido por cualquier usuario, bajo los términos de la licencia GNU/GPL [1].

Para la investigación se uso un sistema operativo GNU/Linux en el cual se pueden implementar herramientas web para la fusión de imágenes satelitales haciendo uso de la TRWH y usando el protocolo HTTP, lo cual hace posible que el código de la aplicación generada pueda quedar accesible a toda la comunidad científica.

Arquitectura de la implementación Web

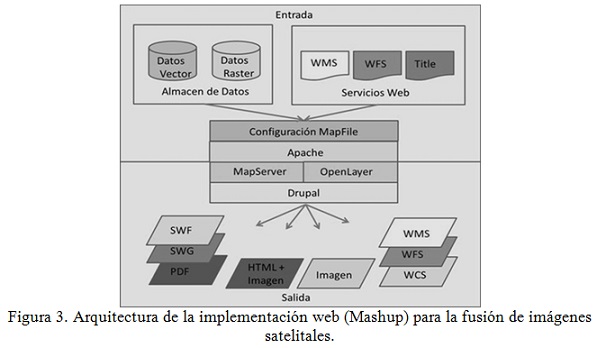

En la figura 3 se observa los procesos que se desarrollaron para la implementación de las herramientas Web usando software libre para la fusión de Imágenes satelitales.

La arquitectura implementada en el servicio Web para fusión de imágenes satelitales, se genera a partir de los datos de entrada (datos vector, datos raster, entre otros) teniendo en cuenta los servicios WMS, WFS y Title. Para generar la información de salida (principalmente la imagen satelital fusionada) se utiliza la configuración MapFile, Apache, MapServer, Open Layer y Drupal.

MapServer

Es una plataforma de código abierto para la publicación de datos espaciales y aplicaciones interactivas de cartografiado en la web. Este es multiplataforma, dentro sus principales características se encuentran:

Dibujo de capas de información dependiendo de la escala.

Dibujo de etiquetas para objetos evitando la colisión entre las mismas.

Elementos de mapas automáticos tales como: escala gráfica, mapas de referencia y leyenda.

Además de lo anterior, es importante decir que MapServer permite programación de elementos cartográficos con lenguajes como PHP, Python, Perl, Ruby, Java, Java Scrip [16].

MapServer crea imágenes de mapa a partir de la información espacial almacenada en formato digital tanto vectorial como raster. Puede leer más de 20 formatos vectoriales diferentes, incluyendo shapefiles, PostGIS y geometrías ArcSDE, OPeNDAP, ArcInfo Coverages y archivos del Census TIGGER. MapServer lee dos formatos raster nativos: GeoTIFF y EPPL7, pero puede leer más de 20 formatos adicionales con el paquete de la libreria GDAL [13]. Los archivos raster pueden ser mostrados como si fueran un elemento vectorial, a través de un renderizado a trozos el cual al final forma un todo con la imagen completa como resultado.

Apache HTTP

Es un software para implementar servicios web desarrollado por la Apache Software Foundation, este se ha convertido en el servidor web más utilizado en el mundo debido a sus altas prestaciones y desempeño [14]. Este software está licenciado bajo open source con la licencia Apache versión 2.0.

Para el caso de uso que se presenta en este artículo el servidor Web Apache proporcionó los servicios necesarios para la implementación del sitio Web el cual se puede realizar haciendo uso de Drupal y de la información geográfica del proyecto, la cual se implementa con la ayuda del software MapServer [15].

Drupal

Es un sistema de gestión de contenidos libre (CMS, del inglés Content Management System), que tiene su propio framework para el desarrollo de módulos escrito en php [16], con licencia GNU/GPL, lleva más de 11 años en constante desarrollo y es mantenido por su comunidad. Se destaca por la calidad de su código, semántica, respecto de los estándares web, la seguridad, y la usabilidad [17]. Drupal como sistema modular permite integrar de una manera rápida y sencilla la recolección de datos a través de módulos como WebForm, el cual se encarga de generar los formularios necesarios para este proceso [17]. El módulo CCK (del inglés Content Construction Kit) se usa para construir los tipos de contenido del sitio.

2.2. Implementación Web del Mashup

El mashup implementado se puede acceder desde el sitio http://200.69.103.29:21032 /proyectofusion/drupal, en el cual se ofrece el servicio web de fusión de imágenes satelitales usando la transformada rápida de wavelet haar, y está conformado por cuatro módulos: “Inicio”, “Ejemplo de fusión FHWT”, “Solicitud de fusión FHWT” y “Administración”.

Modulo de “inicio”

El en modulo de “inicio” (figura 4) se encuentra una introducción de la fusión de imágenes satelitales, el objetivo general, el planteamiento de la investigación y la justificación de la investigación.

En la figura 4 se observa el modulo inicio en el cual los usuarios pueden visualizar el diseño realizado para analizar teóricamente el proceso, ir al ejemplo y solicitar la fusión de imágenes satelitales.

Módulo de “ejemplo de fusión FHWT”

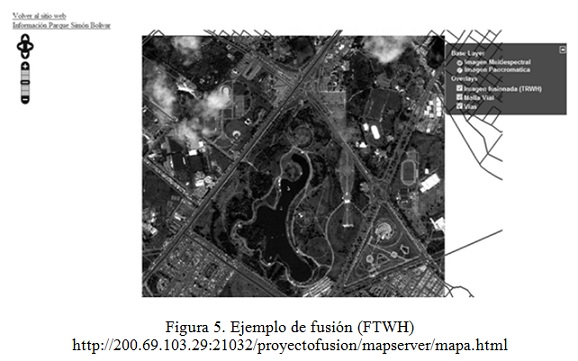

El módulo “ejemplo” es un visor geográfico (figura 5), donde se implementa el Mashup de éste sitio web.

En la figura 5 se observa la imagen fusionada usando TRWH, el usuario puede comparar este resultado con las imágenes originales (pancromática y multiespectral), además puede tener información de la malla vial, vías principales de la zona, además el usuario tiene la opción de regresar a la página principal o, tener mayor información de la zona de estudio.

En su interface aparecen las capas (layers) de información del proyecto. Por un lado los archivos raster, es decir las imágenes Ikonos originales (multiespectral y pancromática), las cuales pueden ser comparadas con la respectiva imagen fusionada resultante de la aplicación de la TRWH. Por otra parte aparece la información vectorial asociada a la zona de estudio como la malla vial y las vías principales. Finalmente, este módulo permite la búsqueda de más información georeferenciada dentro de Internet y la agrega como metadatos en el resultado que es visible en la plataforma. Además utilizando el link “Información Parque Simón Bolívar” se accede a google maps donde se presenta la misma zona de estudio y ofrece la posibilidad de navegar sobre la imagen. Igualmente un marcador ha sido creado sobre el parque Simón Bolívar, el cual al accederlo despliega una descripción sencilla del parque.

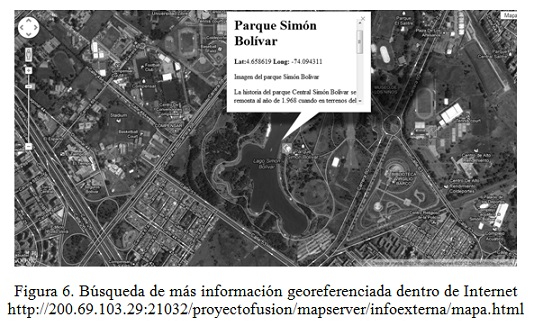

En la figura 6 se observa la información adicional que el usuario tiene como referencia de la zona de estudio. Además mediante el uso de API’s el usuario accede a la interface de Google Earth® sin salir del sitio web objeto de estudio, y por ende puede obtener información diferente al tema de fusión.

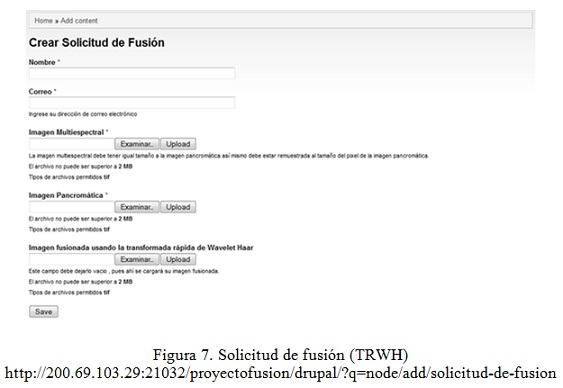

Módulo “solicitud de fusión FHWT”

El módulo “solicitud de fusión FHWT” (figura 7) es donde los usuarios pueden solicitar el servicio de fusión de imágenes a través del sitio Web, para lo cual deben proporcionar dos (2) imágenes satelitales (una multiespectral y una pancromática). El módulo valida las imágenes; las almacena dejándolas disponibles para ser fusionadas con el algoritmo de fusión de imágenes (TRWH, que está escrito en Matlab); alerta, vía correo electrónico, a la persona que envió la solicitud cuando el proceso ha terminado y los datos están disponibles; retorna una imagen fusionada.

En la figura 7 se muestra la interface donde el usuario de la herramienta web puede realizar la solicitud de fusión enviando las imágenes satelitales (pancromática y multiesprectral) de la misma zona.

En su núcleo de éste modulo, la plataforma cuenta con muchas herramientas para el control de los datos que se envían al servidor y es por eso que se usan varias validaciones antes de enviar las imágenes, por ejemplo en el caso de que una imagen no sea diádica, no puede ser procesada y gracias a funciones como “hook_validate()” en drupal [18], pueden controlarse este tipo de errores, lo que evita que el usuario tenga problemas a la hora de enviar sus posibles imágenes para una fusión.

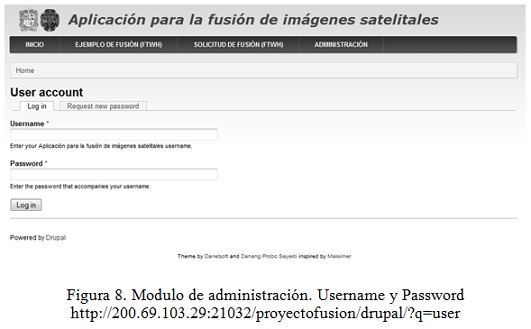

Módulo “administración”

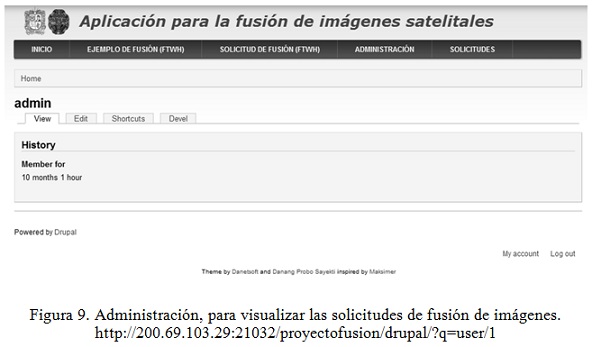

El módulo “administración” permite al administrador del sitio ver las solicitudes pendientes por procesar, así como las que ya se encuentran terminadas. Dicha interface fue creada con el módulo VIEWS de Drupal.

En la figura 8 se observa la interface del modulo de administración en la cual para acceder se requiere tener un Username y un Password. Una vez accedido el sitio se visualiza la información de los datos enviados y el estado de las diferentes solicitudes (figura 9).

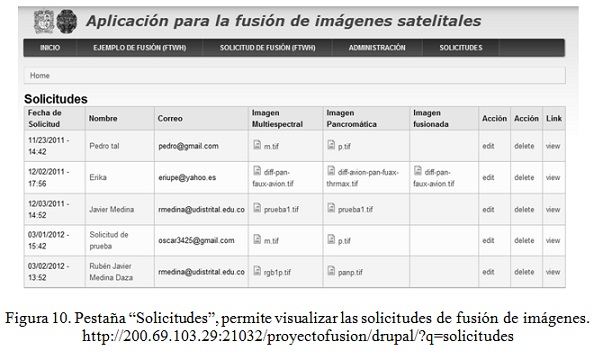

En la figura 9 se observan que aparece un nuevo componente en la interface de la aplicación Web que corresponde a la pestaña “Solicitudes”. En éste modulo se puede visualizar el estados de los datos enviados por los usuarios que han solicitado la fusión de imágenes, e igualmente permite visualizar el estado de las solicitudes (figura 10).

En la figura 10 se observa el modulo de administración “Solicitudes” donde se encuentra el histórico de las solicitudes realizadas por los usuarios. Para cada solicitud se detallan los siguientes campos: Fecha de la solicitud, Nombre, Correo, Nombre de la imagen multiespectral, Nombre de la imagen pancromática, y Estado (indica si la fusión ya ha sido realizada).

2.3. Transformada rápida de wavelet Haar

De manera general el concepto matemático de la transformada de Wavelet se usa para la descomposición de imágenes. Este método se basa en la descomposición de la imagen en múltiples canales basados en su frecuencia local. La transformación de la Wavelet provee un esquema para descomponer una imagen en un nuevo número de imágenes, cada una de ellas con un grado de resolución diferente, lo cual es denominado análisis multiresolución [6].

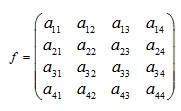

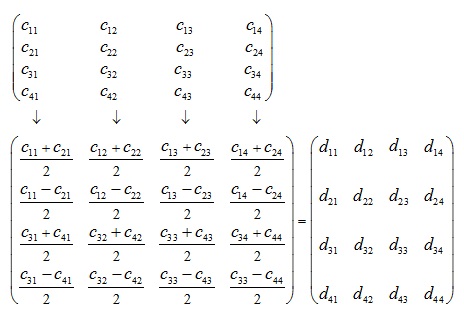

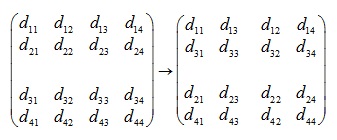

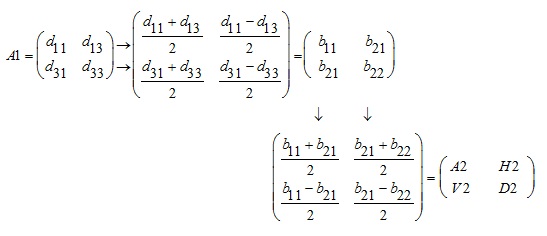

Para ilustrar el modelo matemático de la TRWH y el análisis multiresolución, se utilizará un ejemplo a partir de una matriz de que puede representar una imagen sintética o una sub-imagen satelital.

Considere una función simple de tamaño una matriz cuadrada que cumple la condición de ser diádica [10].

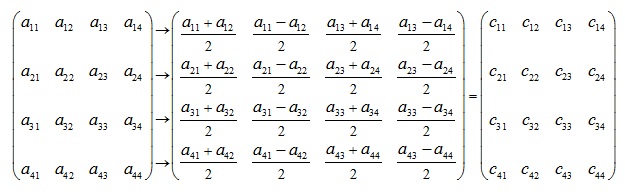

Aplicando una transformada unidimensional para cada columna se tiene una nueva matriz:

Luego se aplica una segunda transformada unidimensional para cada fila de la matriz anterior, se tiene:

Luego se genera una nueva matriz concatenando los coeficientes de la siguiente manera:

Para descomponer la matriz en un segundo nivel de descomposición se realiza con los coeficientes de aproximación A1 de la siguiente manera:

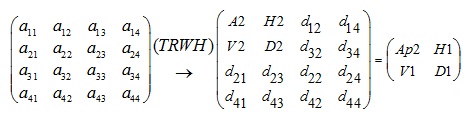

La transformada wavelet completa de dos dimensiones se puede escribir como:

Así surge la transformada completa de wavelet bidimensional rápida de haar.

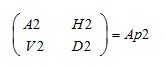

Todos los coeficientes de las esquinas superiores izquierdas corresponden a los coeficientes de aproximación de segundo nivel, que se denotan como Ap2, donde se encuentran los coeficientes H2, V2 y D2.

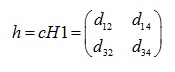

Todos los coeficientes de las esquinas superiores derecha corresponden a los coeficientes de detalle horizontal de primer nivel de descomposición, que se denota como cH1:

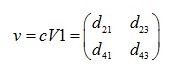

Todos los coeficientes de las esquinas inferior izquierda corresponden a los coeficientes de detalle vertical de primer nivel de descomposición, que se denota como cV1:

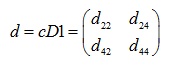

Todos los coeficientes de las esquinas inferior derecha corresponden a los coeficientes de detalle diagonal de primer nivel de descomposición, que se denota como cD1:

3. RESULTADOS

Para la evaluación y análisis de los resultados de las imágenes fusionadas (con las cinco wavelets predefinidas en Matlab y la propuesta en éste trabajo, la TRWH) se tomo como zona de estudio el mismo par de imágenes (Ikonos pancromática y multiespectral) y las imágenes fusionadas se evaluaron utilizando los siguientes índices: coeficiente de correlación (CC), índice RASE, índice ERGAS e índice de calidad universal , los cuales se describen a continuación:

3.1. Coeficiente de correlación (CC)

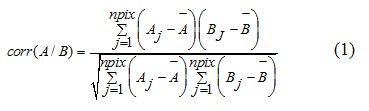

La correlación entres las diferentes bandas de las imágenes fusionadas y las bandas de la imagen original se pueden calcular con la siguiente ecuación:

Donde y

son los valores media de las imágenes correspondientes,

se llama coeficiente de correlación y varía entre –1 y +1. Se usan los signos + y – para las correlaciones positivas y negativas, respectivamente. Nótese que

es una cantidad adimensional, es decir no depende de las unidades empleadas [5].

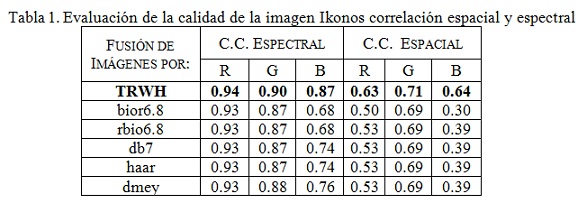

A partir de éste indicador de correlación, dos cálculos diferentes fueron realizados. El primero corresponde al cálculo de un índice de conservación de la resolución espectral que se obtiene de la correlación entre las bandas de las imágenes fusionadas y las bandas de la imagen multiespectral original (ver tabla 1). El segundo corresponde al análisis de la conservación de la resolución espacial, que se obtiene gracias a la correlación de cada una de las diferentes bandas de las imágenes fusionadas (con los diferentes procesos) con la imagen pancromática original (ver tabla 1).

El valor ideal de la correlación, tanto espectral como espacial, entre las bandas de las imágenes fusionadas con las bandas de la imagen original (multiespectral para la correlación espectral y pancromática para la correlación espacial) es 1.

El valor ideal de la correlación, tanto espectral como espacial, entre las bandas de las imágenes fusionadas con las bandas de la imagen original (multiespectral para la correlación espectral y pancromática para la correlación espacial) es 1.

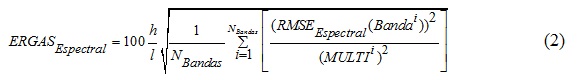

3.2. Índice ERGAS

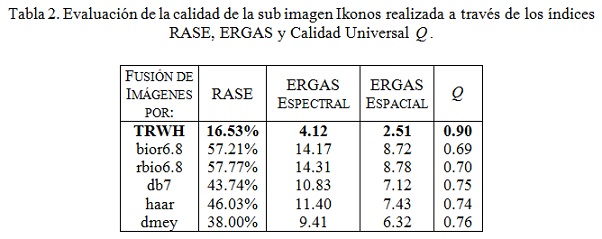

La evaluación de la calidad de las imágenes fusionadas se ha llevado a cabo mediante los índices ERGAS espectral y espacial (ver tabla 2).

La definición de ERGAS espectral (del francés Erreur Relative Globale Adimensionallede Synthèse) [19] viene dada por la ecuación:

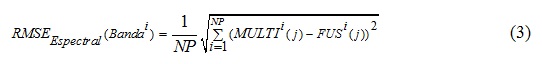

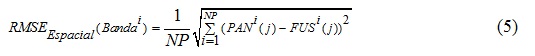

Donde y representan la resolución espacial de las imágenes pancromáticas (PAN) y multiespectrales (MULTI); NBands es el número de bandas de la imagen fusionada; MULTI i es el valor de la radiancia e la banda i-esima de imagen [20] y RMSE será definida como sigue:

Siendo NP el número de píxeles de la imagen FUSi(x,y).

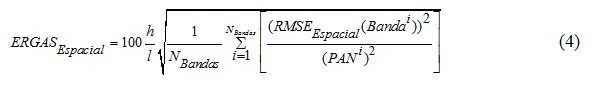

Adicionalmente, Lillo y su equipo proponen otro índice, denominado ERGAS Espacial que está inspirado en el índice ERGAS espectral [12].

El objetivo del índice ERGAS Espacial es evaluar la calidad espacial de las imágenes fusionadas, por lo que se define como:

Donde RMSE Espacial es definido como sigue en la ecuación 5:

Los mejores resultados de éstos índices (ERGAS espacial y espectral) se obtienen cuanto más se acerca a cero (ver tabla 2).

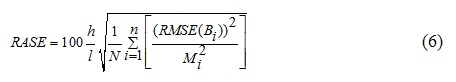

3.3. El índice RASE

El índice RASE se expresa como un porcentaje (ver resultados en la tabla 2):

Donde es la resolución de alta resolución especial (imagen pancromática) y es la baja resolución espectral (imagen multiespectral) [20].

Los mejores resultados se obtienen cuanto el porcentaje está más cerca a cero.

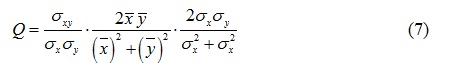

3.4. Índice de calidad universal

Este modelo de índice de calidad identifica cualquier distorsión como una combinación de tres factores: pérdida de correlación, distorsión de luminancia y contraste de distorsión [21]. El índice se obtiene con la siguiente ecuación (ver resultados en tabla 2).

Los mejores valores de este índice se obtienen cuando el valor es más cercano a uno.

En la tabla 1se encuentran los resultados de la correlación espacial y espectral de las imágenes fusionadas con la TRWH y con las cinco wavelet seleccionadas y predefinidas en Matlab.

En la tabla 2se muestran los resultados obtenidos usando los índices RASE; ERGAS espacial y espectral; y el índice de calidad Universal .

A continuación se presenta un análisis sucinto de los resultados obtenidos con los diferentes índices.

En cuanto al coeficiente de correlación espectral para las imágenes multiespectrales originales Ikonos con respecto a las imágenes fusionadas, el valor más alto es de 0,94 corresponde a la banda R, el promedio para la imagen Ikonos imagen fusionada mediante el algoritmo implementado TRWH, se obtuvo el valor más alto con la TRWH 0,90 como promedio.

En cuanto a la correlación espacial entre la imagen pancromática Ikonos y cada una de las bandas de las imágenes fusionadas, con las imágenes Ikonos los mejores valores se consiguen con TRWH con un promedio 0,66.

Con respecto a RASE, ERGAS espectral y índice de calidad Q, los mejores valores de la fusión de imagen con la imagen Ikonos los mejores valores se consiguen con TRWH 25.80%, 6.79 y 0.92, respectivamente.

Con respecto ERGAS espacial los mejores valores de la fusión de imagen con la imagen Ikonos los mejores valores se consiguen con TRWH 2.51.

Los mejores resultados de la evaluación fueron obtenidos con el método propuesto TRWH dado que están en el rango óptimo qué indican que las imágenes fusionadas preservan la riqueza espectral de la imagen multiespectral original y se mejora su calidad espacial.

CONCLUSIONES

La Web se constituye en el escenario en el que convergen los usuarios, los servicios, los medios y las herramientas. Un terreno en el que éstas relaciones tejen redes sociales donde el punto central es la participación de los usuarios. El conjunto de redes, tecnologías y sistemas que conforman la Sociedad de la Información encuentra en la red su principal escenario de acción. En ese espacio dinámico, una Web participativa y colaborativa, donde los usuarios se convierten en protagonistas activos, creando y compartiendo contenidos, opinando, y relacionándose, es la tendencia actual.

En ese contexto la implementación de éste servicio de fusión de imágenes satelitales en la web ofrece grandes posibilidades, en el ámbito académico e investigativo, a los usuarios de procesamiento digital de imágenes. Las investigaciones realizadas anteriormente han demostrado que los métodos de fusión de imágenes basados en la transformada de Wavelet son más adecuados para la fusión de imágenes que los métodos convencionales. Sin embargo, los resultados encontrados (a través del coeficiente de correlación, el índice ERGAS, el índice RASE, y el índice de calidad Universal presentados en la tabla I y II) muestran una ventaja del método propuesto en este artículo TFWH con respecto a otras familias wavelet es que la TRWH permite obtener mejores resultados en la conservación espectral de la información original con una ganancia espacial significativa.

El método propuesto de la TRWH consiste en transformar la composición RGB a IHS, de la Intensidad se extrae los coeficientes cA2i, estos coeficientes contienen la riqueza espectral extraída de la imagen multiespectral de baja resolución espacial, combinando estos coeficientes de aproximación con los coeficientes de detalle cH2p, cV2p, cD2p, cH1p, cV1p y cD1p de la imagen pancromática que contiene la riqueza espacial, los cuales generan la nueva intensidad NI, ésta a su vez se transforma N-IHS a N-RGB; de esta manera se genera la imagen fusionada.

Dado que la TRWH proporcionó los mejores resultados al momento de fusionar imágenes de satélite, esté algoritmo matemático fue seleccionado para implementar un servicio en la Web de fusión de imágenes satelitales. De ésta manera las imágenes fusionadas con el servicio web ofrecen a los usuarios información detallada sobre los entornos urbanos y rurales, lo cual es útil para aplicaciones como la planificación y la gestión urbana. Su utilidad se extiende igualmente al desarrollo de proyectos en diversos campos como agricultura, hidrología, medioambiente y gestión de emergencias producidas por catástrofes naturales (inundaciones, incendios forestales), entre otros.

Referencias

- R. M. Stallman; Software libre para una sociedad libre. Editorial Traficantes de Sueños, edición 1, 2004.

- R. Yee; Pro Web 2.0 Mashups: Remixing Data and Web Services: Apress, edition 1, 2008.

- J. Bennett; OpenStreetMap: Packt Publishing, 2010.

- C. S. Burrus, R. A. Gopinath and H. Guo; Introduction to Wavelets and Wavelet Transforms, Prentice Hall. 1998.

- J. Nuñez, X. Otazu. O. Fors, A. Prades, V. Pala, R. Arbiol; Multiresolution-Based image fusion whit additive wavelet descomposition, IEEE Transactions on Geoscience and Remote Sensing, Vol 37, No 3, pp 1204 -1211, 1999.

- S. Mallat; Wavelets for a vision, Proceedings of the IEEE, Vol 84, No 4, April 1996.

- Y. Nievergelt; Wavelets made easy, Editorial Birkhäuser, Boston, pp 297, 1999.

- R. J. Medina, L. Joyanes, C. Pinilla; Algoritmos matemático para la fusión de imágenes satelitales, V Simposio Internacional de Sistemas de Información e Ingeniería de Software en la Sociedad del Conocimiento, Octubre de 2010.

- Matlab Edición del Estudiante, Versión 4 Guía del usuario, The Math Works Inc. Edition Prentice Hall, 1996.

- R. Medina, C. Pinilla, L. Joyanes; Reconstrucción de una señal sinusoidal y de una imagen sintética usando la transformada de wavelet discreta, Ninth LACCEI Latin American and Caribbean Conference (LACCEI’2011), Engineering for a Smart Planet, Innovation, Information Technology and Computational Tools for Sustainable Development, Medellin, August 3-5, 2011.

- J. Medina, I. Lizarazo; Fusión de imágenes satelitales usando la trasformada de wavelet, Bogotá: Universidad Distrital Francisco José de Caldas, 2004.

- M. Lillo-Saavedra, C. Gonzalo, A. Arquero and E. Martinez; Fusion of multispectral and panchromatic satellite sensor imagery based on tailored filtering in the Fourier domain, International Journal of Remote Sensing, Vol. 26, pp 1263-1268, 2005.

- B. Kropla; Beginning MapServer: Open Source GIS Development, Editorial Appres, 2005.

- R. Bowen, K. Coar; Servidor Apache al Descubierto, Prentice-Hall, Edición 1, 2000.

- B. Laurie, P. Laurie; Apache The guide definitive, O'reilly & Associates, Second Edition, 1999.

- W. J. Gilmore, Beginning PHP and MySQL: From Novice to Professional, Apress 4 edition. September 24, 2010.

- A. Byron, A. Berry, N. Haug , J. Eaton, J. Walker, J. Robbins; Using drupal, O'Reilly media, 1 edition, December 23, 2008.

- J. K. VanDyk, M. Westgate; Pro Drupal Development, Apress; 1 edition April 16, 2007.

- L. Wald; Data fusion, definition and architectures: Fusion of image of different spatial resolution, Paris: Le Presses de l’École des Mines, 2002.

- L. Wald; Quality of high resolution synthesized images: is there a simple criterion?, Proceedings of the third conference Fusion of earth data: merging point measurements, raster maps and remotely sensed image, pp 26-28, 2000.

- Z. Wang, A. C. Bovink; A universal image quality index, IEEE signal processing letters, 2002.

Licencia

Reconocimiento – NoComercial – CompartirIgual (by-nc-sa): No se permite el uso comercial de la obra original, las obras derivadas deben circular con las mismas condiciones de esta licencia realizando la correcta atribución al autor.

Esta obra está bajo una licencia de Creative Commons Reconocimiento-NoComercial-CompartirIgual 4.0 Internacional